近期,多地公安机关发布了多起利用AI工具实施造谣的相关案件。这些案件,颠覆了“有图就有真相”的常规认知,让网络谣言难辨真假。

近日,上海警方发布通报,两名品牌营销人员为蹭热度,编造了“中山公园地铁站捅人”等不实信息,相关人员已被警方行政拘留。通报中,有个细节引人注意:一名造假者使用AI软件生成视频技术,编造了地铁行凶的虚假视频等不实信息,造成恶劣社会影响。

今年1月,某网络平台出现一条关于“西安爆炸”的消息。文字下方还配发了所谓爆炸的图片。这条看起来耸人听闻的消息很快在网上传播,甚至包含了时间、地点等关键信息,极具迷惑性。据了解,这个发布“西安突发爆炸”虚假新闻的账号所属MCN机构最高峰一天能生成4000至7000篇假新闻,每天收入在1万元以上,而公司实际控制人王某某经营着5家这样的机构,运营账号达842个。

去年,在上海一女童走失事件中,一团伙以“标题党”“震惊体”方式,恶意编造炒作“女孩父亲系继父”“女孩被带往温州”等谣言。该团伙利用AI工具等生成谣言内容,通过114个账号矩阵,在6天内发布268篇文章,多篇文章点击量超过100万次。

清华大学新闻与传播学院新媒体研究中心今年4月发布的一份研究报告显示,近两年的AI谣言中,经济与企业类谣言占比最高,达43.71%;近一年来,经济与企业类AI谣言量增速高达99.91%,其中餐饮外卖、快递配送等行业更是AI谣言重灾区。

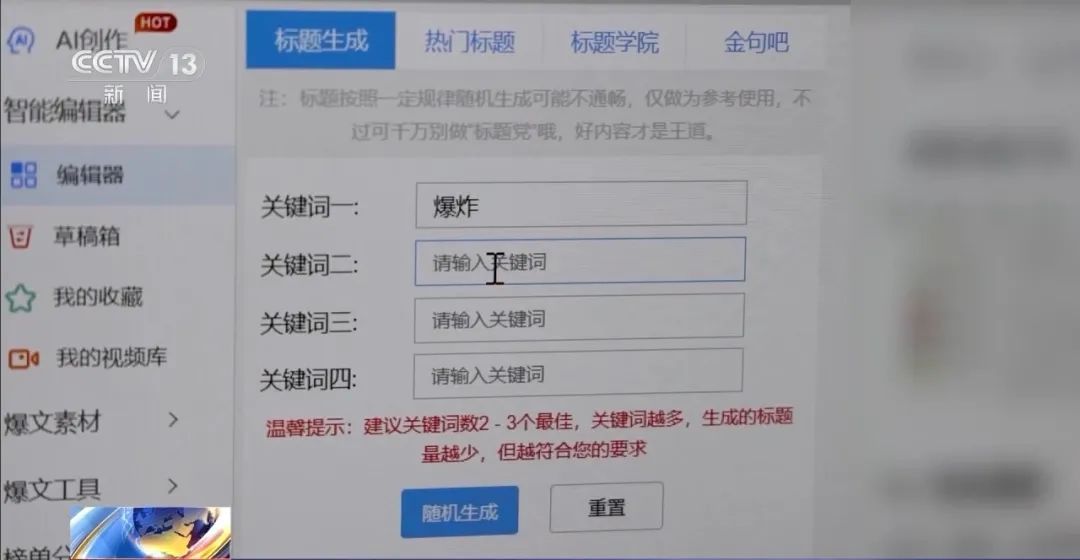

那么,利用AI制造一篇假新闻究竟有多简单?

记者用市面上流行的多款人工智能软件测试发现,只要给出关键词,就能在几秒钟内立刻生成一篇“新闻报道”,包括事情详细经过、评论观点、后续做法等,只要加上时间地点,再配上图片和背景音乐,一篇以假乱真的新闻报道便制作完成。

中国人民大学新闻与社会发展中心研究员曾持说,“生成式AI”的拼接本质和谣言有很强的亲近性,二者都属于“无中生有”——创造看起来真实合理的信息。AI让造谣更加简单和“科学”了,AI根据热点事件总结规律、拼接情节,很快就能制作出符合人们“期待”的谣言,传播更加迅速。

AI造谣的泛滥应当如何治理?请听媒体评论员李啸宇的解读:

Q

利用AI技术制造谣言为什么如此泛滥?治理的难点是什么?

A

第一,AI技术的算力过于强大,它对于什么样的谣言更容易爆火,更容易得到传播,这种判断远远超出人类大脑思考问题的速度;第二,责任难以追查,一个有能力用AI造谣的黑产公司,他也有相应能力把自己掩盖起来;第三,这样的黑色产业能得到巨大收益,这也是让很多人铤而走险的原因;第四,AI技术的发明实在太新了,所以相应的追查机制和监管机制, 现在远远没有跟上。

Q

如何针对性治理?

A

第一,我们得学会“以子之矛,攻子之盾”。我们监管方面也可以相应的发展AI技术来破解、识别AI造谣;第二,相关的立法、执法也需要去加强,可以为警方大规模办理相关案件提供基础。

除此之外,我认为全社会要加强相关人员的教育和科普工作,让公众的辨别力提高。